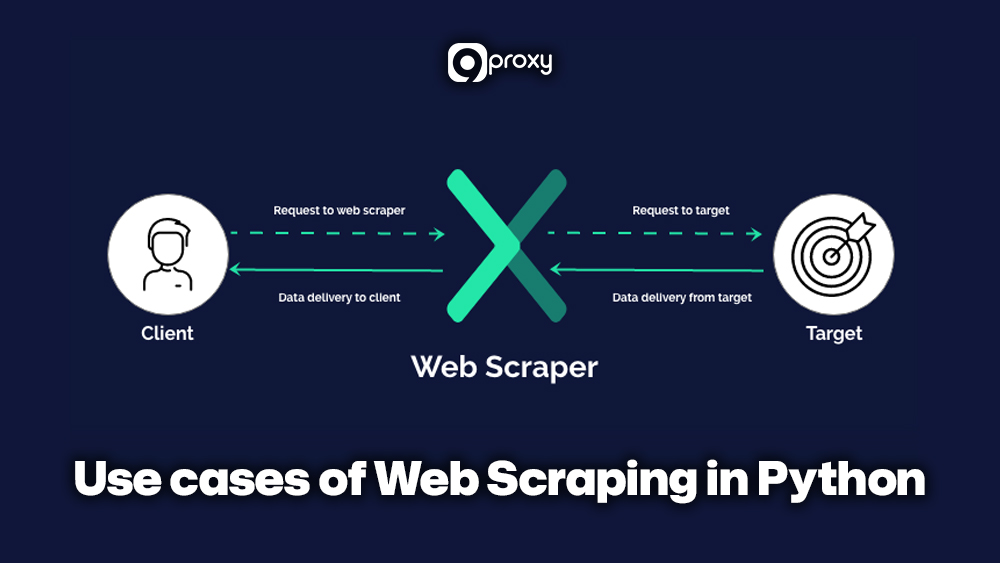

Web scraping(网页抓取)是指使用软件或“机器人”自动从网站中提取数据的过程。它通常包括获取网页内容、解析 HTML 结构以定位特定信息,并将数据存储起来以便分析,常见的存储形式包括电子表格或数据库。网页抓取的常见应用场景有市场调研、价格对比以及潜在客户获取等。

本篇来自 9Proxy 的新手友好指南,将为你介绍在网页抓取中常用的重要 Python 库。从适合基础任务的轻量级工具,到面向大规模、动态抓取项目的高级框架,本文通过实用的对比分析和专业建议,帮助你根据不同技术需求选择最合适的解决方案。读完后,你将能够清楚地了解如何利用 Python 灵活的生态系统,构建稳定、可扩展的网页抓取工作流程。

什么是 Python 中的网页抓取?

Python 中的网页抓取,是指通过 Python 脚本自动从网站中提取数据的过程。它通常包括获取网页的 HTML 内容,并对其进行解析,从而收集诸如价格、用户评价或新闻标题等特定信息。由于 Python 语法简洁、相关库功能强大,无论是初学者还是需要处理静态或动态网页的进阶用户,Python 都是进行网页抓取的理想选择。

许多网页抓取项目都需要同时处理静态页面和由 JavaScript 渲染的动态内容。Python 的灵活性使开发者能够根据具体需求选择合适的工具,无论是采集商品价格、跟踪竞争对手的变化,还是收集研究数据,都能高效完成。

Top 9 Web Scraping Tools and Libraries

Urllib3C

Urllib3 是 Python 内置的强大 HTTP 客户端,非常适合基础级别的网页抓取需求。如果你需要对请求过程进行更精细的控制,并且习惯直接操作底层 HTTP 请求,Urllib3 会是一个不错的选择。

- 优点:它支持连接池、SSL 验证以及代理设置,这些功能有助于你更安全、高效地向网站发送请求。

- 缺点:它本身不具备 HTML 或 JavaScript 解析能力,因此通常需要搭配 BeautifulSoup 等其他工具一起使用。

- 适合使用场景?当你需要对 HTTP 请求进行底层控制,或希望安全地获取原始网页数据时,可以选择使用 Urllib3。

BeautifulSoup

BeautifulSoup 是最受欢迎的 HTML 和 XML 解析库之一。它可以将现实中杂乱、不规范的 HTML 转换为可遍历的对象结构,让你轻松定位并提取所需的元素。

- 优点:API 简单易用,能够方便地从混乱的 HTML 中导航和提取内容;对错误的容忍度高,非常适合初学者。

- 缺点:在处理大规模抓取任务时,速度相比 Scrapy 等更完整的框架会偏慢。

- 适合使用场景?如果是小到中等规模的抓取任务,且主要目标是从静态页面中解析并提取元素,选择 BeautifulSoup 会非常合适。

Requests

Requests 是 Python 中最受欢迎的 HTTP 库之一,因其简洁、直观的 API 而广受欢迎。该库让发送 HTTP 请求变得非常简单,能够自动管理 Cookie、处理身份验证以及跟踪重定向。Requests 将复杂的 HTTP 细节封装起来,使开发者可以专注于抓取逻辑本身,而不是底层的 HTTP 机制。

- 优点:非常易于上手,语法清晰,文档完善;在处理请求头、Cookie 和会话管理方面表现出色。

- 缺点:和 Urllib3 一样,它本身不支持 JavaScript 渲染或内容解析,因此需要搭配其他工具一起使用。

- 适合使用场景?如果需要快速抓取静态网页内容,可以将 Requests 与 BeautifulSoup 或 lxml 结合使用。

MechanicalSoup

MechanicalSoup 充当了网页浏览器与 Python 脚本之间的桥梁。该库提供了高级 API,用于模拟用户在网站上的操作行为,例如填写表单、点击按钮以及页面跳转。MechanicalSoup 结合了 Requests 和 BeautifulSoup 的优势,能够模拟基础的浏览器交互流程。

- 优点:非常适合处理表单填写、Cookie 管理以及页面间的导航,整体使用体验就像在自动化一个真实的用户会话。

- 缺点:并不适合 JavaScript 内容较多的网站,更适用于交互逻辑较为简单的页面。

- 适合使用场景?当你的抓取需求涉及简单的表单提交或登录操作时,可以选择使用 MechanicalSoup。

Selenium

Selenium 是一款功能强大的工具,最初用于浏览器自动化和测试。它可以自动控制真实的浏览器(如 Chrome、Firefox、Safari),让脚本模拟真实用户的操作行为,包括点击按钮、填写表单以及页面滚动等。因此,Selenium 非常适合用于抓取大量依赖 JavaScript 渲染的网站或具有复杂交互的 Web 应用。

- 优点:能够与 JavaScript 元素交互,支持点击、滚动页面,甚至可以处理文件下载等操作。

- 缺点:相比静态抓取方式更“重”,运行速度较慢,同时会消耗更多的系统资源。

- 适合使用场景?当网站内容主要通过 JavaScript 动态加载时,使用 Selenium 会是更合适的选择。

Pandas

Pandas 是一个数据分析库,在你完成原始数据抓取之后会显得非常有价值。通过其 read_html() 函数,Pandas 可以直接解析网页中的 HTML 表格,并将其转换为结构化的 DataFrame。除了抓取之外,Pandas 在数据清洗、转换和分析方面表现出色,是网页抓取后数据处理阶段不可或缺的工具。

- 优点:支持强大的数据处理与转换能力,非常适合对抓取到的数据进行清洗和分析。

- 缺点:本身不负责获取网页数据,而是在抓取完成后使用。

- 适合使用场景?在完成网页抓取后,使用 Pandas 将数据整理并导出为 CSV、Excel 或数据库等格式。

ZenRows

ZenRows 是一款网页抓取 API,用于屏蔽和简化反爬虫机制及代理管理的复杂流程。该服务通过统一的 API,自动处理代理轮换、验证码(CAPTCHA)破解、JavaScript 渲染以及反爬虫绕过等问题。

- 优点:可自动完成 JavaScript 渲染、代理轮换以及应对各种反爬虫挑战,大幅降低抓取难度。

- 缺点:免费额度有限,在进行大规模项目时通常需要订阅付费方案。

- 适合使用场景?非常适合对稳定性要求高、且需要应对反爬虫机制的生产级网页抓取项目。

Playwright

Playwright 是由微软开发的一款现代化浏览器自动化框架,支持多种无头浏览器(如 Chromium、Firefox、WebKit)。它能够很好地处理动态内容和复杂交互,并内置了网络拦截、上下文隔离等高级功能。

- 优点:相比 Selenium,页面加载速度更快,对现代 JavaScript 特性的支持也更好。

- 缺点:对初学者来说,上手难度略高一些。

- 适合使用场景?非常适合需要执行 JavaScript、且页面交互较多的现代化网站抓取。

Scrapy

Scrapy 是一个专为大规模项目和专业级使用而构建的网页抓取框架。它几乎涵盖了网页抓取所需的全部功能,包括内置的爬虫机制、数据提取、数据存储以及中间件支持等。

- 优点:内置爬取、数据管道和数据导出功能,整体性能非常高,速度快、效率高。

- 缺点:配置和使用相对复杂,对初学者来说不如 BeautifulSoup 或 Requests 友好。

- 适合使用场景?当你需要抓取大量页面,并对大型抓取项目进行统一管理时,Scrapy 是非常合适的选择。

如何选择最合适的网页抓取库?

选择合适的工具取决于你的具体需求。下面的对比表可以帮助你做出决策:

| 库名称 | 最适合的场景 | 是否支持 JavaScript | 学习成本 | 是否适合初学者 |

| Urllib3 | 基础 HTTP 请求 | 否 | 低 | 是 |

| BeautifulSoup | 解析静态 HTML | 否 | 低 | 是 |

| MechanicalSoup | 简单交互(表单、登录) | 否 | 低 | 是 |

| Requests | 轻松发送网页请求 | 否 | 低 | 是 |

| Selenium | 动态 JavaScript 内容 | 是 | 中 | 是 |

| Pandas | 数据分析与格式化 | N/A | 低 | 是 |

| ZenRows | 绕过反爬虫检测 | 是 | 低 | 是 |

| Playwright | 快速浏览器自动化 | 是 | 中 | 是 |

| Scrapy | 可扩展的大规模抓取项目 | 有限 | 高 | 否 |

根据项目的复杂程度,9Proxy 建议从 Requests + BeautifulSoup 这样的组合入手,在需求更高级时再逐步过渡到 Playwright 或 Scrapy。当然,你也可以根据网站类型、项目规模以及技术需求来选择合适的工具,从而优化你的 Python 网页抓取工作流程。

在抓取过程中,你还可以了解一下 nstbrowser,它能够提供关于如何自动化浏览流程的实用参考和思路。

Python 网页抓取的应用场景

Python 网页抓取并不只是开发者的专属工具,它同样适用于任何需要大规模获取网页数据的人。以下是一些常见且具有实际价值的应用场景,展示了 Python 网页抓取可以发挥作用的地方:

- 竞争对手分析:跟踪竞争对手网站上的价格变化、产品更新以及内容策略,帮助你在市场中保持领先。

- 价格对比:从多个电商平台收集价格数据,用于提供最优报价或监控价格趋势。

- 潜在客户获取:从公开的目录或商业列表中提取联系方式(如邮箱、电话号码)来建立潜在客户名单。结合 LinkedIn 网页抓取工具使用,在定位专业用户方面尤其有效。

- 情感分析:收集用户评价或社交媒体内容,用于分析公众对某个产品、品牌或事件的看法。

- 社交媒体数据分析:抓取 Reddit、Twitter、Instagram 等平台上的用户互动数据、话题标签或趋势信息。

- 研究与新闻:为学术研究收集结构化数据,或监控突发新闻及公开数据来源。

这些示例表明,Python 网页数据抓取不仅能支持商业情报分析,也能为内容策略和研究工作提供有力支持。

使用 Python 构建网页爬虫的分步指南

既然你已经了解了它的应用场景,接下来我们来拆解如何真正构建一个可运行的网页爬虫。下面将从环境搭建到问题排查,带你一步步了解关键流程。

网页抓取前的环境准备

在开始编写代码之前,你需要先准备好工作环境:

- 安装 Python 3,并确保已添加到系统的 PATH 中。

- 使用 venv 或 virtualenv 创建虚拟环境,以便管理项目依赖。

- 安装所需的库,例如:

pip install requests beautifulsoup4 scrapy selenium pandas

这样配置可以确保你的爬虫稳定运行,并避免不同项目之间的依赖冲突。

网页抓取流程

构建一个网页爬虫通常可以分为几个清晰的步骤,下面是具体做法:

第 1 步:确定目标数据

使用浏览器的 “检查” 工具,找出页面中目标数据所在的位置,例如是在某个 <div> 标签中、特定的 class 里,还是通过 JavaScript 动态加载的内容。

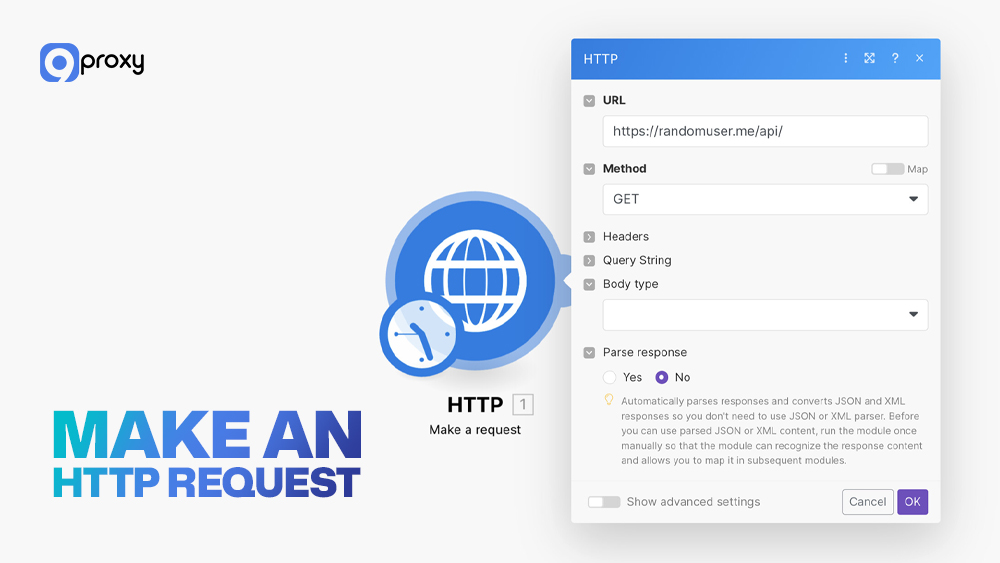

第 2 步:发送 HTTP 请求

使用 Requests 获取网页内容:

import requests

response = requests.get(“https://example.com”)

在某些情况下,尤其是下载资源或使用命令行工具时,开发者也可能会通过配置 wget 代理,将请求安全地转发到代理服务器上。

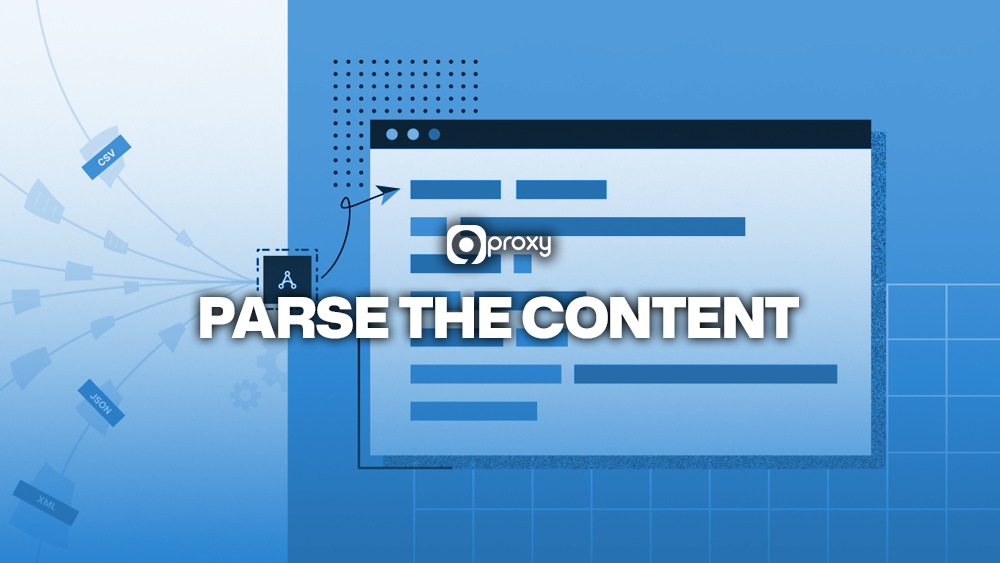

第 3 步:解析页面内容

使用 BeautifulSoup 将 HTML 转换为可操作的结构:

from bs4 import BeautifulSoup

soup = BeautifulSoup(response.text, ‘html.parser’)

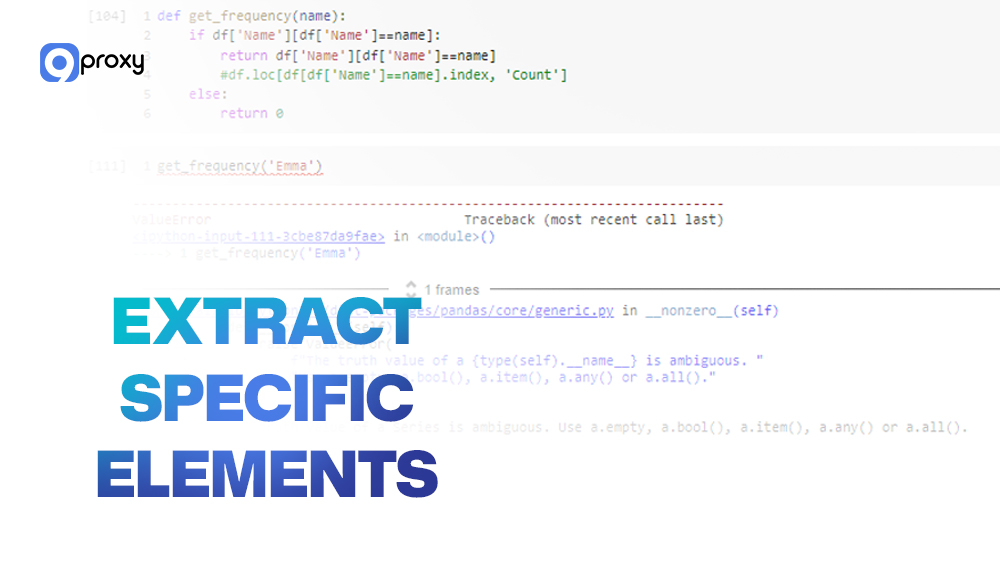

第 4 步:提取指定元素

使用 .find() 或 .find_all() 来获取目标数据:

titles = soup.find_all(“h2″, class_=”title”)

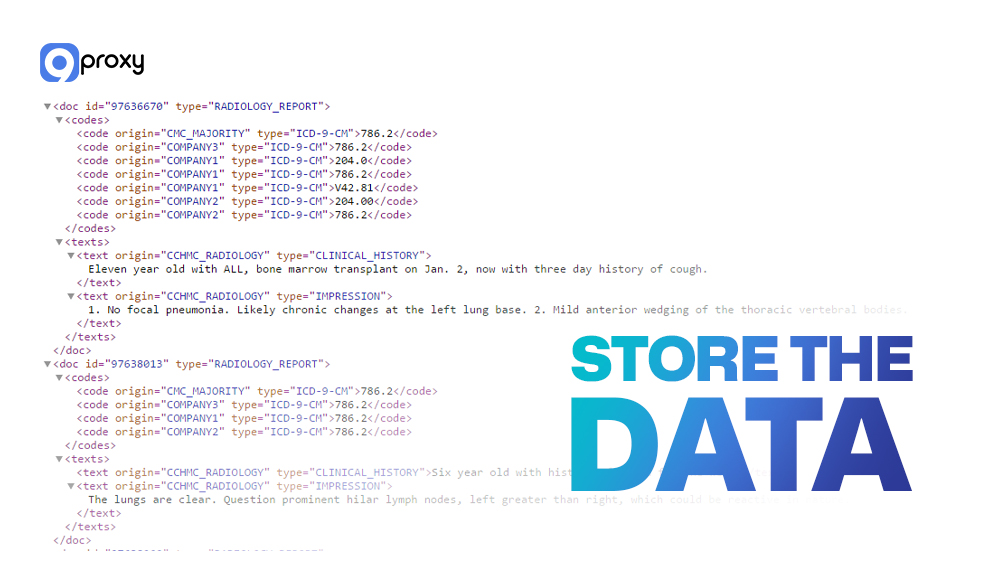

第 5 步:存储数据

可以使用 Python 内置的 csv 模块,或借助 Pandas 将数据保存为 CSV 文件:

import pandas as pd

df = pd.DataFrame(titles)

df.to_csv(“output.csv”, index=False)

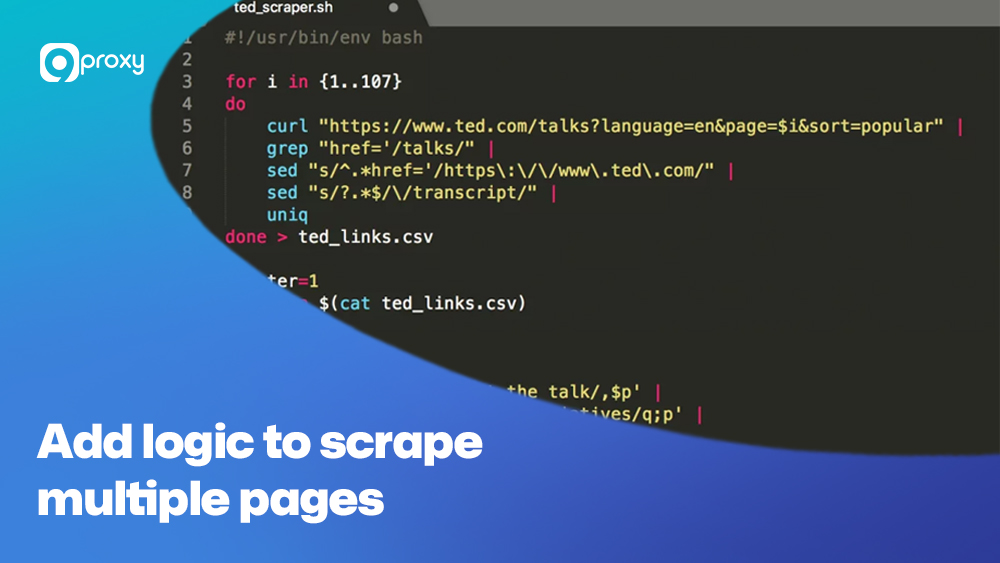

第 6 步:添加多页抓取逻辑

使用循环或递归来处理分页,或应对「加载更多」按钮等场景。

通过这样的流程,即使是规模较大的网站,也可以使用结构清晰、可重复执行的代码,有条不紊地完成抓取。

处理 Python 网页抓取中的常见问题

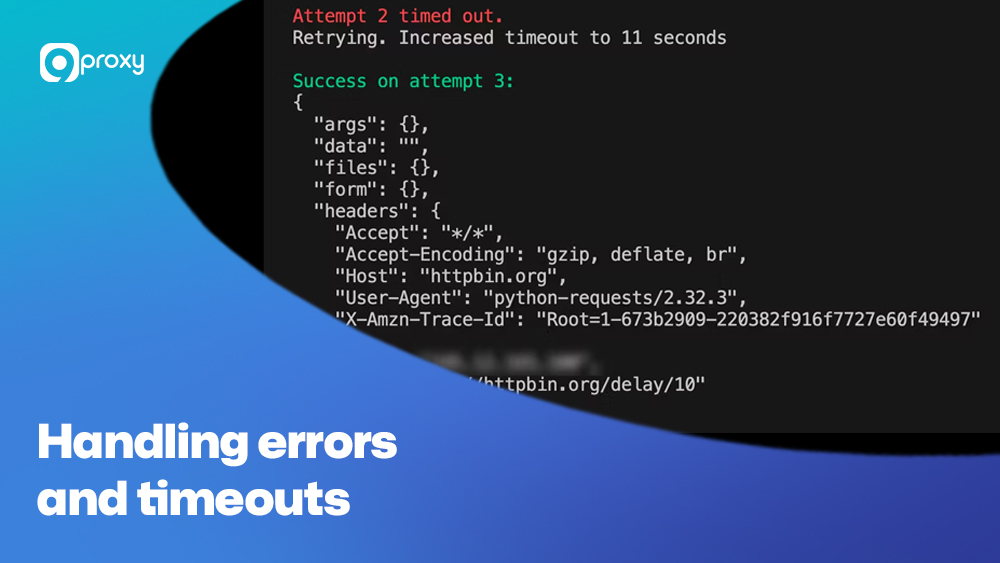

应对错误与超时情况

网页抓取过程中经常会遇到连接中断、403 错误或请求超时等问题。可以通过使用 try/except 语句、重试机制以及设置请求间隔来提升程序的稳定性:

import time

from requests.exceptions import RequestException

try:

response = requests.get(url)

except RequestException:

time.sleep(5)

# retry logic here

避免 IP 被封禁

许多网站都会检测并封锁爬虫行为。为了降低被识别和封禁的风险,可以采取以下措施:

- 使用网页抓取代理服务(例如 9Proxy 提供的代理)

- 添加自定义请求头和 User-Agent

- 在请求之间加入随机延迟

- 使用 VPN 或 Tor 来提升匿名性

在进行大规模抓取任务时,代理尤其实用,不仅能有效降低封禁风险,还能避免频繁触发验证码(CAPTCHA)。

结论

Python 网页抓取为从互联网上获取数据提供了一种灵活且可扩展的方式。借助对新手友好的库(如 Requests 和 BeautifulSoup),以及更高级的工具(如 Playwright 或 Scrapy),你可以抓取从普通博客到动态电商平台的各种内容。

在 9Proxy,我们始终认为,使用代理是确保爬虫稳定、安全运行的关键。无论你是在做价格对比、获取潜在客户,还是进行情感分析,选择合适的工具和合适的代理,都会让工作事半功倍。

准备好扩展你的抓取项目了吗?立即探索我们提供的免费或付费 Python 网页抓取代理解决方案,开启你的抓取之旅吧。